I modelli di intelligenza artificiale continuano a crescere in dimensioni, complessità e costi operativi. Più aumentano i parametri, più diventa difficile farli funzionare in modo rapido, stabile e sostenibile dal punto di vista economico. Il problema, sostengono ormai da tempo ingegneri e operatori del settore, non riguarda solo la potenza di calcolo.Riguarda soprattutto la memoria.

È qui che si forma uno dei principali colli di bottiglia dell’attuale infrastruttura AI: il cosiddetto memory wall, il muro della memoria.

Su questo fronte punta a inserirsi Majestic Labs AI, startup fondata da tre ex manager passati da Google e Meta. L’azienda sostiene di aver progettato un nuovo sistema server, chiamato Prometheus, pensato per affrontare proprio questo limite.

L’obiettivo dichiarato è permettere l’esecuzione di modelli linguistici enormi, nell’ordine di 5.000-10.000 miliardi di parametri, senza costringere data center e clienti a comprare quantità crescenti di chip solo per avere abbastanza memoria disponibile.

La società, nata dall’iniziativa di Ofer Shacham, Masumi Reynders e Sha Rabii, ha annunciato a novembre una raccolta da 100 milioni di dollari con il sostegno di investitori tra cui Bow Wave Capital, Lux Capital e Grove.

I tre fondatori hanno lavorato in Google sullo sviluppo e sulla commercializzazione delle prime generazioni di chip per data center e dispositivi mobili, per poi contribuire alla costruzione del team dedicato al silicio personalizzato di Meta Reality Labs.

Ora provano a ritagliarsi uno spazio in uno dei segmenti più affollati e strategici dell’industria tecnologica: quello dei semiconduttori per l’intelligenza artificiale.

Indice degli argomenti:

Il nodo della memoria nei modelli più grandi

Negli ultimi anni il dibattito sui chip per l’AI si è concentrato spesso sulla capacità di calcolo. Nvidia è diventata il simbolo di questa corsa, grazie a gpu sempre più richieste per addestrare ed eseguire modelli generativi. Ma quando si passa dall’allenamento dei sistemi al loro impiego quotidiano, cioè alla fase di inference, emerge un problema meno visibile e altrettanto decisivo: la memoria disponibile per contenere il modello e alimentarne le risposte in tempo reale.

Quando un modello è molto grande, i chip possono trovarsi nella condizione paradossale di restare in attesa invece di lavorare. Hanno capacità di calcolo elevatissima, ma non abbastanza memoria locale per tenere a disposizione tutti i dati necessari. Il risultato è che devono recuperare informazioni da altri chip vicini o da altri livelli della gerarchia di memoria, con un rallentamento che annulla parte del vantaggio prestazionale.

Secondo Majestic, questo è il punto in cui molte infrastrutture attuali iniziano a perdere efficienza e redditività.

Sha Rabii ha sintetizzato il problema in modo diretto: quando la memoria non basta, i chip ad alte prestazioni rimangono inattivi mentre aspettano di ottenere risorse aggiuntive da altri componenti. In pratica, la velocità di elaborazione non viene sfruttata fino in fondo perché il sistema non riesce a nutrire i processori con la rapidità necessaria. Per i modelli più grandi, sostiene l’azienda, questa dinamica rende sempre meno sostenibile l’uso dell’infrastruttura esistente.

La proposta di Majestic Labs AI

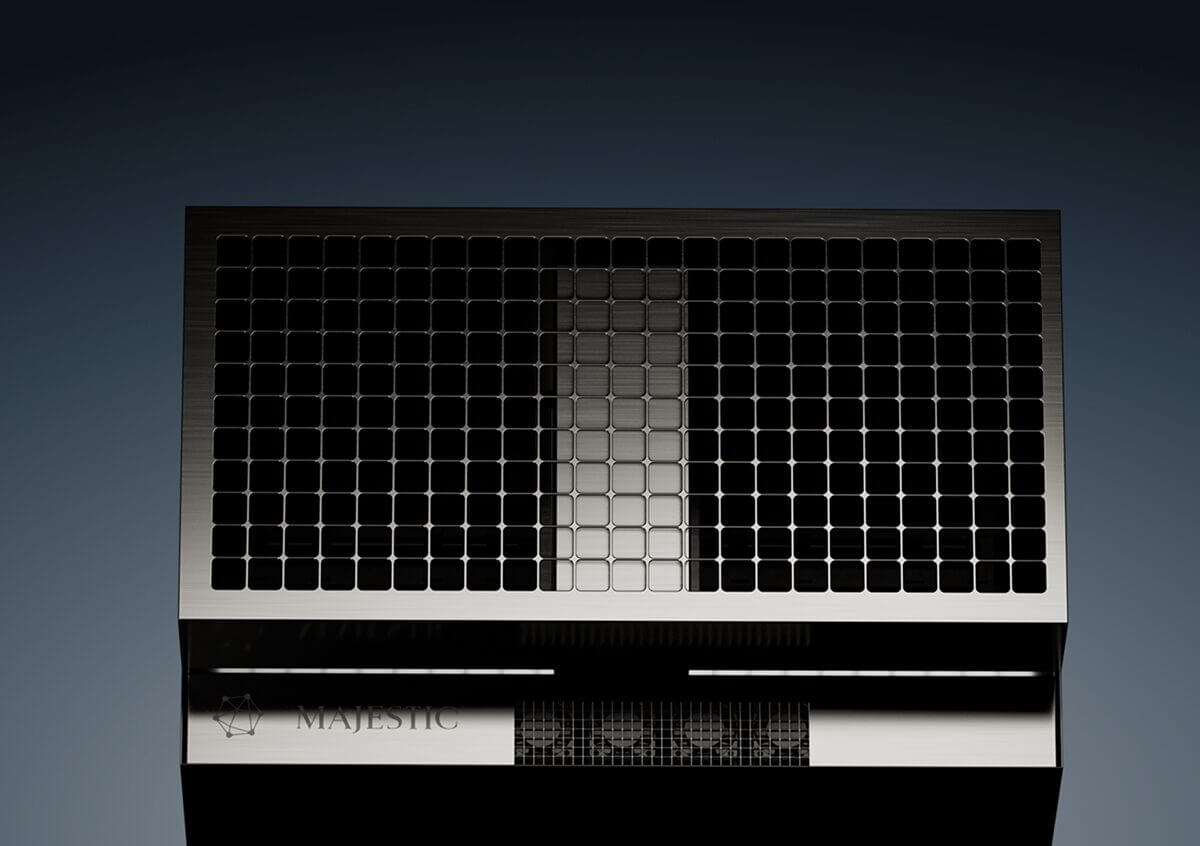

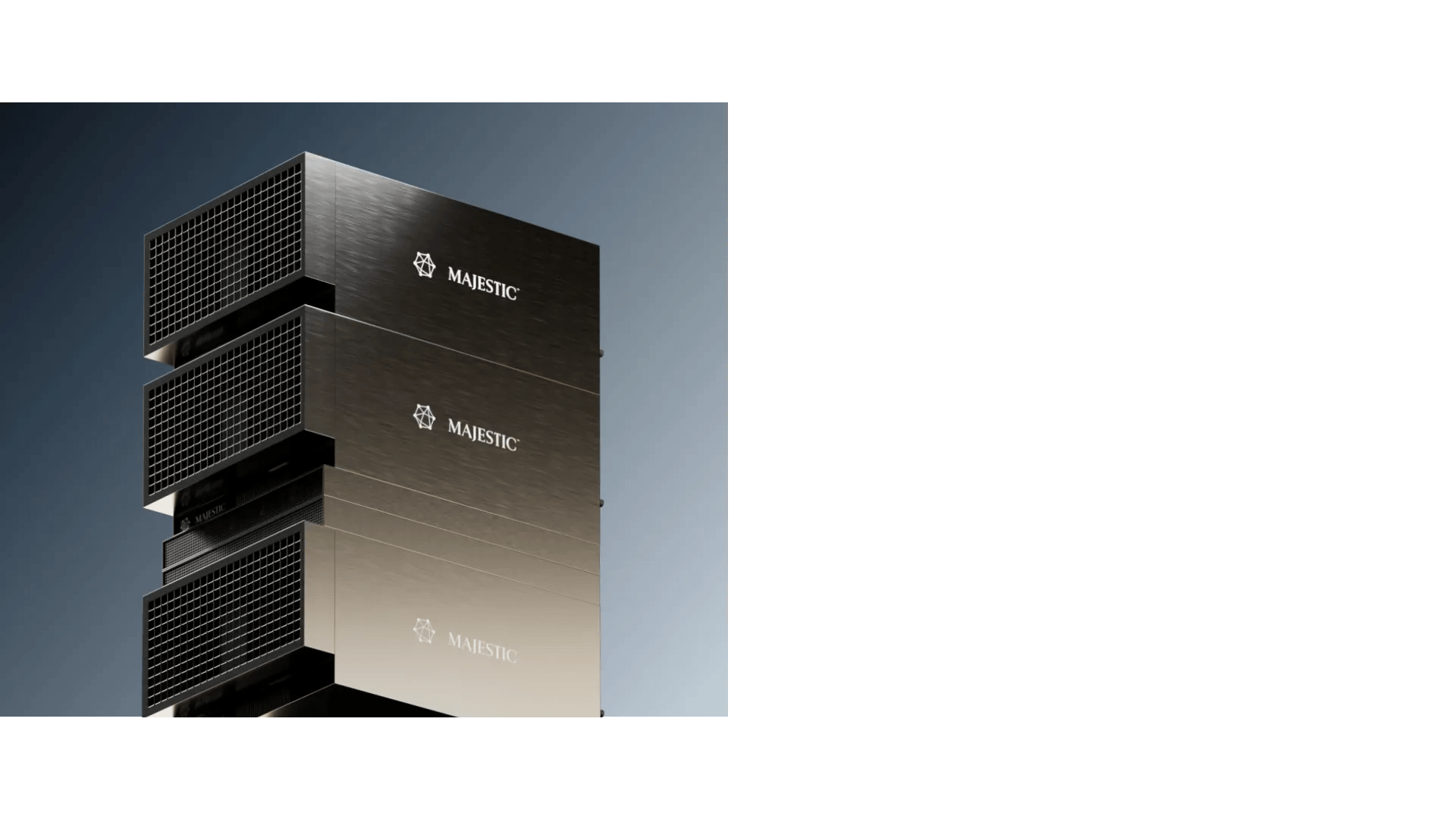

Majestic afferma di aver progettato un’architettura diversa da quelle oggi dominanti. Il suo nuovo sistema server, Prometheus, integra centinaia di chip proprietari denominati AIU – sigla che sta per artificial intelligence processing unit. I fondatori sostengono che la caratteristica centrale del sistema non sia tanto la sola potenza di calcolo, quanto la quantità di memoria ad alta velocità che può essere associata ai processori.

Secondo quanto dichiarato dall’azienda, Prometheus può arrivare fino a 128 terabyte di memoria veloce per server. La configurazione sarebbe personalizzabile in base alle esigenze del cliente. La promessa è ambiziosa: eseguire in modo fluido modelli da 5 a 10 trilioni di parametri. Per rendere l’idea della distanza rispetto ai sistemi concorrenti, i fondatori affermano che i loro server offrano una capacità di memoria fino a 1.000 volte superiore rispetto alle Gpu prodotte da rivali come Nvidia.

Ofer Shacham, amministratore delegato della startup, ha descritto Prometheus come il primo processore per l’AI costruito partendo dalla memoria, e non dal calcolo, per affrontare i volumi richiesti dai modelli più grandi. È una scelta progettuale che prova a ribaltare la logica dominante del settore.

Invece di accumulare potenza e aggiungere memoria in un secondo momento, Majestic afferma di aver progettato il sistema a partire dal vincolo che oggi pesa di più sull’inferenza.

Perché l’inferenza è diventata il nuovo campo di battaglia

Il contesto di mercato aiuta a capire perché una startup come Majestic stia attirando attenzione e capitali. L’esplosione dell’AI generativa ha creato una domanda enorme non solo di chip per l’addestramento, ma anche di componenti capaci di rispondere rapidamente alle richieste degli utenti, consumando meno energia possibile.

L’inferenza è il momento in cui il modello produce testo, immagini, codice o altre risposte. È anche la fase che, su larga scala, può trasformare l’AI in un servizio commerciale costoso da mantenere.

La crescita dell’agentic AI, cioè di sistemi autonomi in grado di eseguire compiti come la scrittura di software o la gestione di processi complessi, ha aggravato la pressione sulle infrastrutture. Più agenti lavorano in parallelo, più aumentano le richieste di memoria, larghezza di banda e disponibilità di chip. In questo scenario i prezzi di noleggio dei componenti avanzati sono saliti in modo marcato, mentre alcuni servizi di intelligenza artificiale hanno registrato più interruzioni o hanno dovuto limitare l’uso da parte dei clienti.

Per molte aziende, quindi, il problema non è solo trovare potenza, ma trovarla a un costo che lasci margini. Se per eseguire un modello servono più chip del necessario solo per ottenere memoria sufficiente, l’intera architettura diventa meno efficiente. È da questo squilibrio che Majestic tenta di trarre vantaggio.

La concorrenza corre sullo stesso terreno

Majestic non si muove in uno spazio vuoto. L’inferenza è già diventata un terreno di scontro tra grandi gruppi e startup specializzate.

Advanced Micro Devices (AMD) ha promosso le sue nuove generazioni di chip come soluzioni adatte a questa fase operativa.

Nvidia, che resta il riferimento del mercato, ha rafforzato la sua presenza anche su questo segmento: alla fine dello scorso anno ha pagato 20 miliardi di dollari per ottenere in licenza la tecnologia e assumere il team dirigente della startup Groq, e ha poi annunciato un nuovo server orientato proprio all’inferenza.

Anche Google Cloud ha comunicato che la nuova generazione dei suoi processori TPU includerà un chip ottimizzato per il training e un altro specifico per l’inferenza, con attenzione alla memoria ad alta larghezza di banda.

Cerebras, altra società che lavora sui chip per l’inferenza, ha siglato quest’anno un accordo importante con Amazon Web Services e ad aprile ha presentato la documentazione per la quotazione in Borsa.

Questi movimenti indicano due cose. La prima è che il mercato vede nell’inferenza il passaggio decisivo per monetizzare davvero l’AI su larga scala. La seconda è che nessuno, neppure i leader consolidati, considera risolto il problema dell’equilibrio tra calcolo, memoria, consumi e costi.

Majestic entra quindi in una corsa già aperta, ma lo fa con una tesi precisa: le soluzioni attuali non offrono ancora memoria sufficiente per i modelli che arriveranno nei prossimi anni.

Comprare memoria senza pagare potenza inutile

Qui si colloca uno degli argomenti commerciali più forti della startup. Secondo i fondatori, molti acquirenti oggi sono costretti a comprare più potenza computazionale di quella realmente necessaria soltanto per ottenere il volume di memoria richiesto dai modelli. In altri termini, si acquistano processori aggiuntivi non perché servano a fare più calcoli, ma perché portano con sé altra memoria.

Rabii ha riassunto questa distorsione con una metafora efficace: è come avere bisogno di un garage nuovo e sentirsi dire che per averlo bisogna comprare una casa nuova. Applicata al mercato dei chip, la frase individua un punto sensibile per operatori cloud, grandi laboratori e imprese che sviluppano prodotti AI.

Se il costo della memoria continua a essere incorporato in sistemi sovradimensionati dal lato del calcolo, l’economia dell’inferenza rischia di peggiorare proprio mentre la domanda cresce.

Majestic sostiene di poter spezzare questo meccanismo offrendo grandi quantità di memoria senza imporre la stessa escalation sul fronte dei processori. La scommessa industriale è evidente: convincere il mercato che il valore non sta soltanto nei teraFLOPS, ma nella possibilità di usare davvero quella potenza senza lasciare i chip in attesa.

La scelta della DRAM comune contro l’HBM

Un altro elemento distintivo del progetto riguarda il tipo di memoria utilizzata. I fondatori spiegano di voler fare affidamento esclusivamente su chip DRAM standard, cioè componenti considerati di massa e meno costosi, invece di dipendere dalla memoria HBM, oggi molto ricercata nei sistemi AI di fascia alta.

La HBM, o high-bandwidth memory, garantisce velocità elevate ma richiede processi produttivi più complessi, basati sull’impilamento tridimensionale di più chip DRAM. Questo la rende più difficile da produrre e, in una fase di forte domanda, più soggetta a colli di bottiglia nella catena di fornitura. Le carenze di memoria necessaria per costruire server AI, avvertono molti produttori, potrebbero proseguire fino al prossimo anno e forse oltre.

Majestic prova a trasformare questo limite di mercato in un argomento competitivo. Usare solo DRAM standard, sostiene la società, consente di attenuare gli effetti della stretta sull’offerta e di contenere i costi. Il punto, però, è dimostrare che questa scelta non penalizzi le prestazioni. Per farlo l’azienda punta su quella che definisce la propria tecnologia proprietaria di interconnessione.

La tecnologia proprietaria come vero fattore decisivo

Secondo i fondatori, il cuore del vantaggio competitivo di Majestic non è soltanto nel chip AIU, ma nel modo in cui processori e memoria vengono collegati. La startup afferma di aver sviluppato una tecnologia di interconnessione proprietaria capace di connettere i processori a oltre 100 terabyte di memoria per server, con velocità di trasferimento dati superiori a quelle dell’HBM e senza richiedere consumi elettrici eccessivi.

È una dichiarazione importante, perché tocca il punto più delicato di qualunque architettura basata su grandi volumi di memoria esterna al processore. Avere molta memoria serve a poco se il sistema non riesce a muovere i dati abbastanza in fretta. Allo stesso tempo, aumentare drasticamente la banda può far salire i consumi e rendere il server meno appetibile. Majestic dice di poter tenere insieme tre obiettivi che raramente coincidono: molta memoria, alta velocità di accesso e costi energetici contenuti.

Per ora, però, si tratta di affermazioni della società. Il mercato, soprattutto in un comparto tecnico come questo, chiederà prove concrete: benchmark indipendenti, implementazioni reali, disponibilità della catena produttiva e capacità di mantenere le promesse su scala industriale.

Gli ordini annunciati e la prova del mercato

La startup sostiene di avere già più clienti in attesa, per un volume potenziale di ricavi nell’ordine di centinaia di milioni di dollari a partire dal 2027. Non ha però fornito nomi, spiegando che gli accordi sono ancora riservati. È un dettaglio che non sorprende in questa fase, ma che lascia aperta una domanda essenziale: chi è disposto a scommettere su una nuova architettura in un settore dominato da fornitori affermati?

Per un cliente enterprise o cloud, cambiare piattaforma non significa solo comprare hardware diverso. Significa verificare compatibilità software, tool di sviluppo, affidabilità operativa, assistenza, roadmap e capacità di consegna. In altre parole, una buona idea tecnologica da sola non basta. Serve dimostrare che il prodotto può essere integrato in infrastrutture complesse e supportato nel tempo.

Qui Majestic dovrà misurarsi con il vantaggio accumulato da operatori come Nvidia, Google, AMD e Amazon, che non vendono soltanto chip, ma ecosistemi completi. Il fatto che i fondatori arrivino da Google e Meta può aiutarli sul piano della credibilità tecnica e delle relazioni industriali. Ma la distanza tra prototipo promettente e adozione su larga scala resta ampia.

“Per l’avvio di un server di intelligenza artificiale in grado di superare il limite della memoria, consentendo l’esecuzione di carichi di lavoro di intelligenza artificiale intensivi con un consumo energetico ridotto.”

Una partita che riguarda costi, tempi e controllo dell’AI

La proposta di Majestic Labs AI fotografa bene il punto in cui si trova oggi l’industria dell’intelligenza artificiale. Dopo la corsa iniziale alla potenza di calcolo, l’attenzione si sposta su ciò che determina davvero i costi di esercizio: memoria, consumi, disponibilità di componenti, tempi di risposta. Per le aziende che vogliono distribuire modelli sempre più grandi, questo passaggio è decisivo.

Se il memory wall continuerà a frenare le prestazioni, l’espansione dei modelli potrebbe scontrarsi con un limite economico prima ancora che tecnico. Se invece architetture come quella proposta da Prometheus riusciranno a dimostrare di funzionare, il mercato dei server AI potrebbe cambiare rapidamente, aprendo spazio a nuovi concorrenti e riducendo la dipendenza da pochi fornitori dominanti.

Per ora Majestic presenta una tesi ambiziosa, capitali freschi e una narrazione chiara: i chip per l’AI non devono solo calcolare di più, devono soprattutto smettere di aspettare la memoria. È su questo terreno che si giocherà una parte rilevante della prossima fase dell’economia dell’intelligenza artificiale.