A dicembre del 2023, in un intervento agli Stati Generali dell’AI alla Luiss[1], proposi una lista di temi che per ragioni diverse non erano trattati dall’AI ACT, allora ancora in bozza, e che avrebbero dovuto essere oggetto di una disciplina nazionale.

In generale, può essere oggetto di una diversa disposizione rispetto all’AI ACT:

- ciò che è specificato espressamente nel regolamento come escluso dalla sua applicazione;

- ciò che pur in tema di AI non è assolutamente oggetto del regolamento né direttamente né indirettamente;

- ambiti specifici: ad esempio la rilevanza penale è lasciata a ogni Stato membro.

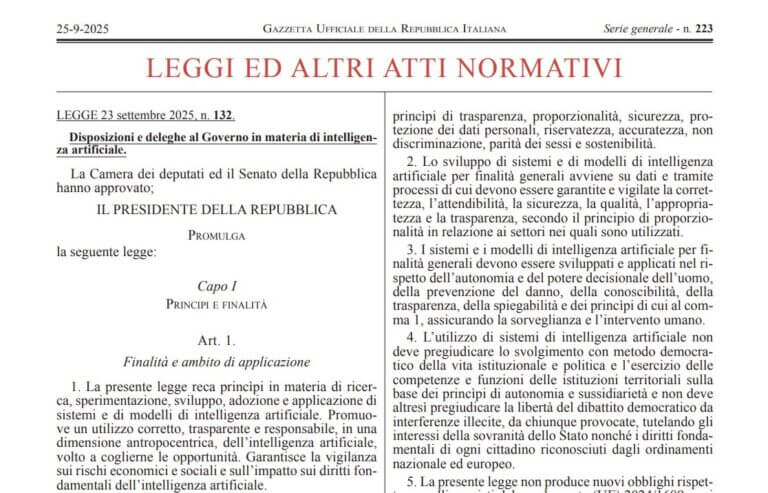

Gran parte di quei temi sono oggi disciplinati in modo organico ed esaustivo nella legge 132/2025.

Indice degli argomenti:

Legge 132/2025: i temi introdotti rispetto all’AI ACT

AI e salute

Il tema è ampiamente trattato dagli articoli 7 ed 8 della legge 132/2025 che offrono una disciplina chiara degli utilizzi dei sistemi di AI in ambito sanitario, confermando, tra l’altro, al comma 5 dell’art. 7, la centralità della decisione del professionista e offrendo per la prima volta un quadro di riferimento unitario a livello nazionale sul tema.

Va detto che è ancora opportuna una analisi e una successiva disciplina legislativa volta all’allineamento delle previsioni dell’art 5 c.c., nel rispetto dei principi dell’art.32 cost, alle nuove possibilità offerte dalle tecniche di potenziamento, Enhanced Human Technologies.

Tutela dei minori

La materia della tutela dei minori trova nella legge 132/2025 una disciplina esaustiva dell’aspetto più delicato, quello della validità del consenso del minore. L’ art.4 comma 4 impone che l’accesso alle tecnologie di intelligenza artificiale da parte dei minori di anni quattordici nonché il trattamento dei loro dati personali richiedono il consenso di chi esercita la responsabilità genitoriale lasciando alla scelta del minore di anni diciotto, che abbia compiuto quattordici anni, la possibilità di esprimere il proprio consenso per il trattamento dei dati personali connessi all’utilizzo di sistemi di intelligenza artificiale.

Coordinamento in materia di AI

Il comma 6 dell’art.19 della legge 132/2025 prevede l’istituzione del Comitato di coordinamento delle attività di indirizzo sugli enti, organismi e fondazioni, che operano nel campo dell’innovazione digitale e dell’intelligenza artificiale. La sua ampia composizione[2] assicura in modo strutturale quello scambio di diverse competenze che è indispensabile per la corretta comprensione e indirizzo di uno strumento così ampio e pervasivo come l’AI. Il rischio, in assenza di tale organo, è che una specifica “visione “ delle conseguenze dell’utilizzo dei sistemi di AI possa prevalere e che non si abbia una valutazione completa di tutti i possibili impatti.

Tutela penale ampliata

L’art.26 della legge 132/2025 introduce il nuovo reato di Illecita diffusione di contenuti generati o alterati con sistemi di intelligenza artificiale prevedendo un nuovo articolo del codice penale, l’Art. 612 -quater; l’articolo 26, inoltre, integra le previsioni dell’art. 2637 c.c in tema di “Aggiotaggio” prevedendo la pena della reclusione da due a sette anni se il fatto è commesso mediante l’impiego di sistemi di intelligenza artificiale.

Rimangono tuttavia ancora alcuni temi che non sono oggetto né della disciplina del Regolamento né di quella nazionale:

- la previsione di una personalità elettronica è indispensabile per una diffusione “serena” dei sistemi di AI. La reintroduzione del concetto di personalità elettronica, presente nei documenti preparatori all’AI Act, quali la Risoluzione del Parlamento europeo del 16 febbraio 2017 (2015/2103(INL)), consentirebbe di istituire uno status giuridico specifico, la personalità elettronica, che comporterebbe la responsabilità legale del sistema di AI per il risarcimento dei danni causati.

- l’assicurazione obbligatoria diffusa analoga a quella obbligatoria per la circolazione dei veicoli di cui all’art. 122 del Codice della Strada, che con la personalità elettronica contribuirebbe ad abbassare il livello di attenzione e remora nell’utilizzo diffuso di sistemi di AI anche non ad alto rischio.

- la disciplina della nuova professione di chi controlla la correttezza dell’input e dell’output essenziale per evitare errori nell’addestramento o nella valutazione del risultato che possano diffondersi e ingenerare danni anche ampliati dall’ormai acclarato fenomeno dell’affidamento dell’umano al risultato dell’AI.

Uno strumento legislativo periodico nazionale

Infine, vorrei ricordare una esigenza che l’AI rende non più procrastinabile, quella della previsione di uno strumento legislativo periodico nazionale, ad esempio annuale, che possa rispondere alle necessità dello sviluppo tecnologico: il deep fake e l’AI generativa sono oggetto dell’ AI Act solo per la complessità del processo di approvazione dei Regolamenti dell’Unione Europea, e la loro disciplina è stata introdotta con gli emendamenti del dicembre 23, più di due anni dopo la presentazione del testo originale.

Note

- https://www.luiss.it/evento/2023/12/14/stati-generali-diritto-internet-ia. Il medesimo tema è stato oggetto in relazione alla necessità di definire una autorità di coordinamento nell’articolo: Profili regolatori, giudizio delle Autorità e responsabilità nelle applicazioni di intelligenza artificiale, di Antongiulio Lombardi e Giulio Lombardi in Intelligenza artificiale e diritto: una rivoluzione? Amministrazione, responsabilità, giurisdizione. Vol. II Alessandro Pajno, Filippo Donati, Antonio Perrucci (a cura di) ↑

2. E’ presieduto dal Presidente del Consiglio dei ministri o dall’Autorità politica delegata e composto dal Ministro dell’economia e delle finanze, dal Ministro delle imprese e del made in Italy, dal Ministro dell’università e della ricerca, dal Ministro della salute, dal Ministro per la pubblica amministrazione, dall’Autorità delegata per la sicurezza della Repubblica e per la cybersicurezza e dall’Autorità politica delegata in materia di innovazione tecnologica e transizione digitale o da loro delegati ↑